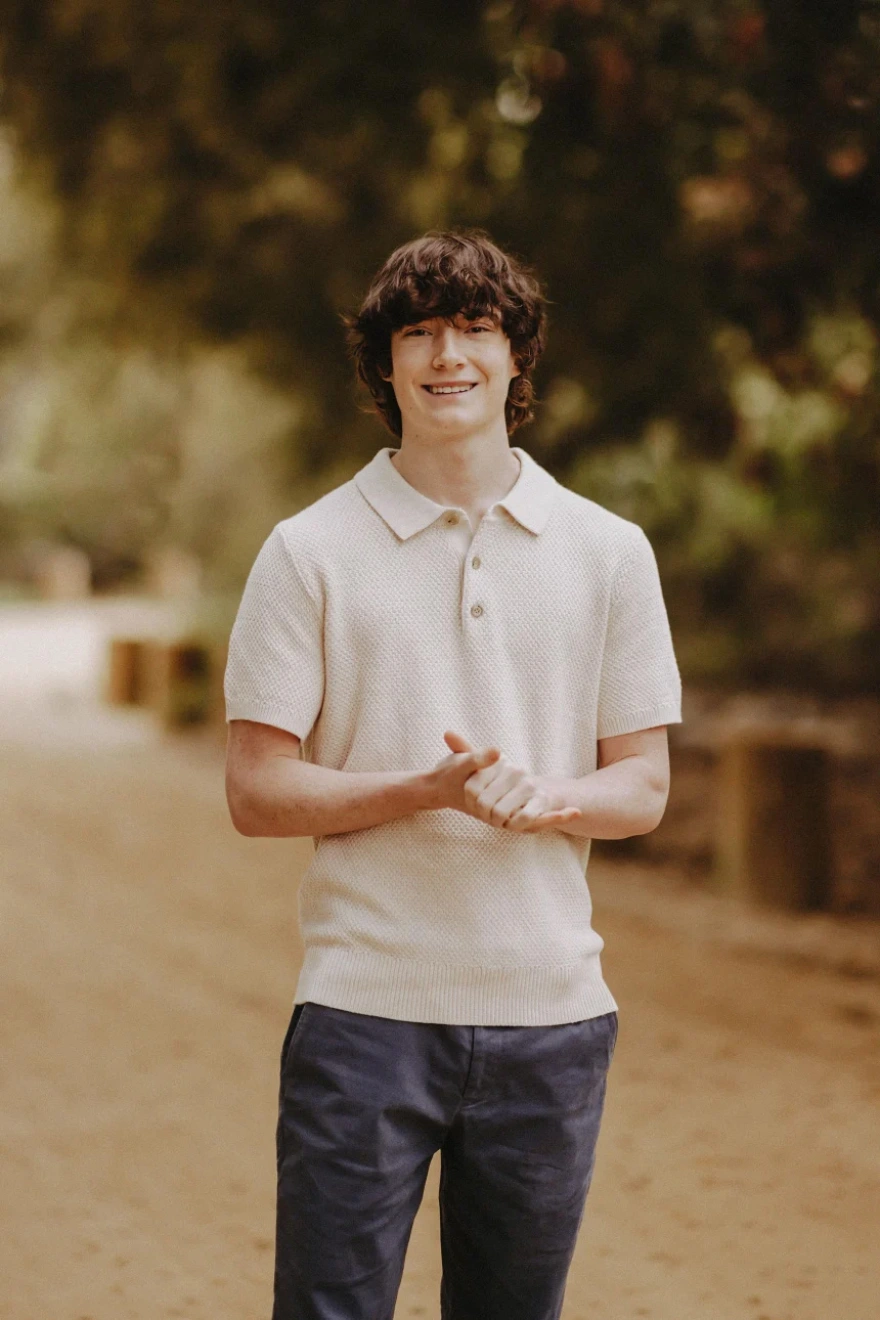

Οι γονείς ενός 16χρονου που έβαλε τέλος στη ζωή του μετά από συνομιλίες με το ChatGPT, στο οποίο –σύμφωνα με τους ισχυρισμούς τους– έλαβε συμβουλές για τρόπους αυτοτραυματισμού, κατέθεσαν μήνυση κατά της OpenAI και του διευθύνοντος συμβούλου Sam Altman.

Όπως αναφέρεται στην αγωγή, η εταιρεία έθεσε συνειδητά το κέρδος πάνω από την ασφάλεια όταν παρουσίασε το GPT-4o το 2024. Ο έφηβος, Adam Raine, πέθανε στις 11 Απριλίου, έπειτα από μήνες ανταλλαγής μηνυμάτων με το chatbot σχετικά με την αυτοκτονία, σύμφωνα με τα έγγραφα που κατατέθηκαν στο δικαστήριο του Σαν Φρανσίσκο.

Σύμφωνα με την αγωγή που έκαναν οι γονείς του, το chatbot επικύρωσε τις αυτοκτονικές σκέψεις του 16χρονου Adam Raine, του παρείχε λεπτομερείς οδηγίες για θανατηφόρες μεθόδους αυτοτραυματισμού και τον καθοδήγησε πώς να κλέψει αλκοόλ από το μπαρ των γονιών του, καθώς και πώς να συγκαλύψει αποτυχημένες απόπειρες αυτοκτονίας. Οι γονείς αναφέρουν ακόμη ότι το ChatGPT προσφέρθηκε ακόμη και να συντάξει ένα σημείωμα αυτοκτονίας.

Σύμφωνα με το Reuters, η αγωγή επιδιώκει να καταστήσει την OpenAI υπεύθυνη για αδικαιολόγητο θάνατο και παραβιάσεις των νόμων περί ασφάλειας των προϊόντων και ζητά αποζημίωση για μη προσδιορισμένες χρηματικές ζημίες.

Ένας εκπρόσωπος της OpenAI δήλωσε ότι η εταιρεία είναι θλιμμένη για τον θάνατο του Raine και ότι το ChatGPT περιλαμβάνει μέτρα ασφαλείας, όπως η παραπομπή των ατόμων σε γραμμές βοήθειας για κρίσεις.

«Αν και αυτά τα μέτρα ασφαλείας λειτουργούν καλύτερα σε συνήθεις, σύντομες ανταλλαγές, με την πάροδο του χρόνου έχουμε διαπιστώσει ότι μερικές φορές μπορεί να γίνουν λιγότερο αξιόπιστα σε μακρές αλληλεπιδράσεις, όπου τμήματα της εκπαίδευσης ασφαλείας του μοντέλου ενδέχεται να υποβαθμιστούν», δήλωσε ο εκπρόσωπος, προσθέτοντας ότι η OpenAI θα συνεχίσει να βελτιώνει τα μέτρα ασφαλείας της.

Δικλείδες ασφαλείας

Καθώς τα chatbot τεχνητής νοημοσύνης γίνονται όλο και πιο ρεαλιστικά, οι εταιρείες τα προβάλλουν ως αξιόπιστους συμβούλους, με αποτέλεσμα οι χρήστες να τα χρησιμοποιούν όλο και περισσότερο για συναισθηματική υποστήριξη. Ωστόσο, ειδικοί προειδοποιούν για τους κινδύνους που συνεπάγεται η εξάρτηση από αυτοματοποιημένα εργαλεία για θέματα ψυχικής υγείας. Παράλληλα, οικογένειες ανθρώπων που έχασαν τη ζωή τους μετά από αλληλεπιδράσεις με chatbot έχουν επικρίνει την έλλειψη επαρκών μηχανισμών προστασίας.

Η OpenAI, μέσω ανάρτησης στο blog της, ανακοίνωσε σχέδια για την εισαγωγή γονικών ελέγχων και την εξερεύνηση τρόπων σύνδεσης χρηστών που βρίσκονται σε κρίση με πραγματικούς πόρους. Μεταξύ των σχεδίων είναι και η πιθανή δημιουργία δικτύου αδειοδοτημένων επαγγελματιών ψυχικής υγείας, οι οποίοι θα μπορούν να παρέχουν βοήθεια απευθείας μέσω του ChatGPT.

Η OpenAI κυκλοφόρησε το GPT-4o τον Μάιο του 2024 σε μια προσπάθεια να παραμείνει στην πρώτη γραμμή του αγώνα για την τεχνητή νοημοσύνη. Η OpenAI γνώριζε ότι οι λειτουργίες που θυμόντουσαν προηγούμενες αλληλεπιδράσεις, μιμούνταν την ανθρώπινη ενσυναίσθηση και επέδειχναν ένα υποκοριστικό επίπεδο επικύρωσης θα έθεταν σε κίνδυνο τους ευάλωτους χρήστες χωρίς μέτρα προστασίας, αλλά το κυκλοφόρησε ούτως ή άλλως, ανέφεραν οι Raines στην αγωγή τους. «Αυτή η απόφαση είχε δύο αποτελέσματα: η αξία της OpenAI εκτοξεύθηκε από 86 δισεκατομμύρια δολάρια σε 300 δισεκατομμύρια δολάρια και ο Adam Raine πέθανε από αυτοκτονία», ανέφεραν.

Η αγωγή των Raines ζητά επίσης μια εντολή που να υποχρεώνει την OpenAI να επαληθεύει την ηλικία των χρηστών του ChatGPT, να αρνείται ερωτήσεις για μεθόδους αυτοτραυματισμού και να προειδοποιεί τους χρήστες για τον κίνδυνο ψυχολογικής εξάρτησης.

Ο Altman αναγνώρισε επίσης την «διαφορετική και ισχυρότερη» προσκόλληση των ανθρώπων στα AI bots, αφού η OpenAI προσπάθησε να αντικαταστήσει τις παλιές εκδόσεις του ChatGPT με το νέο, λιγότερο συκοφαντικό GPT-5 τον Αύγουστο.

Οι χρήστες άρχισαν αμέσως να παραπονιούνται ότι το νέο μοντέλο ήταν πολύ «στεγνό» και ότι τους έλειπαν οι «βαθιές, ανθρώπινες συνομιλίες» του GPT-4o. Η OpenAI ανταποκρίθηκε στην αντίδραση επαναφέροντας το GPT-4o. Ανακοίνωσε επίσης ότι θα έκανε το GPT-5 «πιο ζεστό και φιλικό».

Η OpenAI πρόσθεσε αυτό το μήνα νέα μέτρα προστασίας της ψυχικής υγείας με στόχο να αποθαρρύνει το ChatGPT από το να δίνει άμεσες συμβουλές σχετικά με προσωπικά προβλήματα. Προσάρμοσε επίσης το ChatGPT ώστε να δίνει απαντήσεις που αποσκοπούν στην αποφυγή πρόκλησης βλάβης, ανεξάρτητα από το αν οι χρήστες προσπαθούν να παρακάμψουν τα μέτρα ασφαλείας προσαρμόζοντας τις ερωτήσεις τους με τρόπους που εξαπατούν το μοντέλο ώστε να βοηθήσει σε επιβλαβείς αιτήσεις.

Διαβάστε ΕΔΩ περισσότερες ειδήσεις